@frankm aus Zeit mangel hat sich der Umbau in die Länge gezogen, jetzt ein kleinen Einblick auf den jetzigen Stand!

SBC:

$ uname -a

Linux RockHomeServer 5.10.21-rockchip64 #21.02.3 SMP PREEMPT Mon Mar 8 01:05:08 UTC 2021 aarch64 GNU/Linux

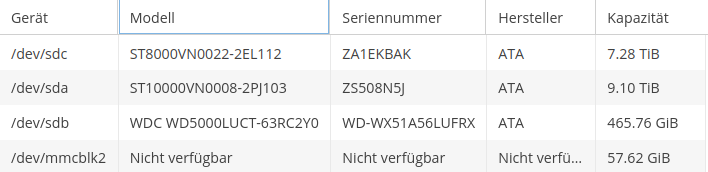

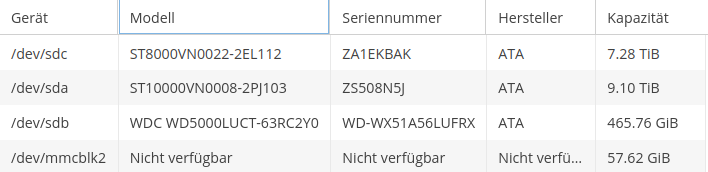

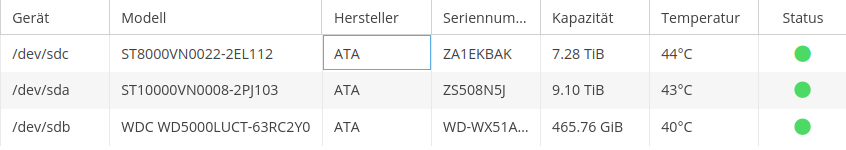

Eingebauten HDD:

- 500GB Disk model: WDC WD5000LUCT-63RC2Y0

- 8TB - Disk model: ST8000VN0022-2EL

- 10TB - Disk model: ST10000VN0008-2PJ103

Aufrüst Artikel:

Test:

$ lspci

00:00.0 PCI bridge: Fuzhou Rockchip Electronics Co., Ltd RK3399 PCI Express Root Port

01:00.0 SATA controller: Marvell Technology Group Ltd. Device 9215 (rev 10)

Eingebunden über OMV

$ blkid

/dev/mmcblk2p1: UUID="4c710410-bb67-49b3-8272-e7d1fdf5e9ae" TYPE="ext4" PARTUUID="df7a56c6-01"

/dev/sda1: LABEL="Daten4" UUID="f2d5e525-2aa1-44f0-aa53-df5d03d4b6cb" TYPE="ext4" PARTUUID="1d7e383d-1c7d-4d1e-ac34-7942bb0eb304"

/dev/sdb1: LABEL="Daten2" UUID="8d1e1a98-758c-43a7-bf48-383db52c96f8" TYPE="ext4" PARTUUID="ab473501-0aff-4914-934c-3c47c9951cdd"

/dev/sdc1: LABEL="Daten3" UUID="8859d90b-152f-4a9e-a426-90280878631c" TYPE="ext4" PARTUUID="7ee795e3-6792-41d8-959f-3dc74649d47a"

/dev/mmcblk2: PTUUID="df7a56c6" PTTYPE="dos"

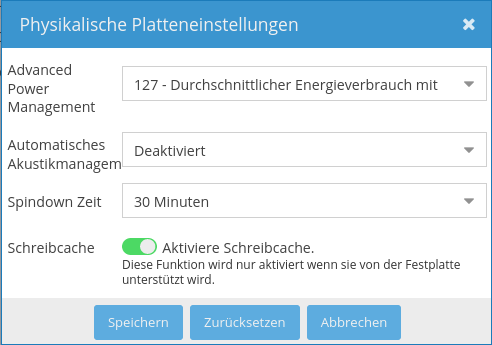

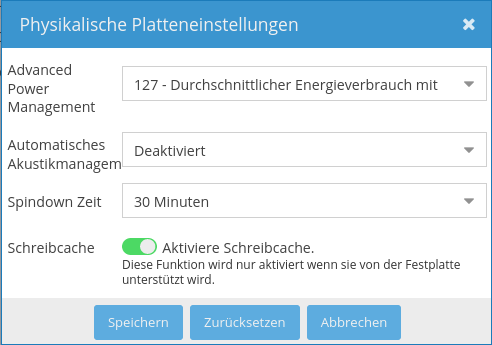

OMV Physikalische Platteneinstellungen (hdparm)

Speed Test der bei mir Standard mäßig verwendet wird:

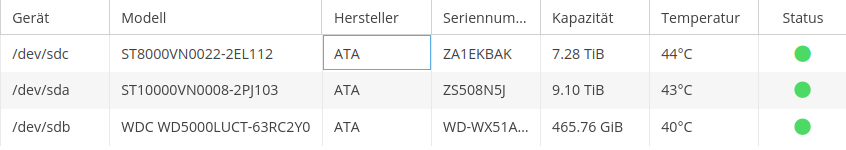

Temperatur:

$ 'date' && sudo hddtemp /dev/sda && sudo hddtemp /dev/sdc && sudo hddtemp /dev/sdb && sudo hdparm -C /dev/sda && sudo hdparm -C /dev/sdc && sudo hdparm -C /dev/sdb

Do 11. Mär 13:30:17 CET 2021

/dev/sda: ST10000VN0008-2PJ103: Laufwerk schläft

/dev/sdc: ST8000VN0022-2EL112: Laufwerk schläft

/dev/sdb: WDC WD5000LUCT-63RC2Y0: 39°C

/dev/sda:

drive state is: unknown

/dev/sdc:

drive state is: unknown

/dev/sdb:

drive state is: active/idle

Standby Temperatur ca. 40°C im Metal Desktop/NAS Casing.

Mein farzit:

Ich bin zu 85% Prozent zufrieden. Es funktioniert und macht was es soll!

Somit habe ich leider nicht viel gewohnen, das einzige dass meine 500GB HDD 2,5 Zoll platz im NAS Casing gefunden hat (vorher über externe USB Adapter angeschloßen).

+

- Festplatten wurden ohne Probleme erkant und Eingebunden.

- Platteneinstellungen sind konfigurierbar.

- Kein Ausfahl beobachtet.

-

- Seitliche LED leuchten permanent. (stört etwas)

- Schreib / Lese geschwindigkeit ist langsamer geworden. (ca. 90 MiB/s vorher ca. 130 MiB/s)

Desweiteren: (hängt aber am Software)

hddtemp und hdparm zeigen falsche werde an.

- Ausgabe von hddtemp ist permanent Laufwerk schläft

- Ausgabe von hdparm ist drive state is: unknown

Was erst zur verwirrung bei mir sorgte.

Nach langem ausprobieren ist einfach, die Ausgabe von hddtemp: Laufwerk schläft ist zu ignorieren und nur bei Laufender / Aktiver HDD zu beachten um die Temperatur auszulesen.

Beim hdparm: drive state is: unknown bedeutet das die HDD Aktiv ist. Und nur bei output standby ist auch würklich die HDD im standby und schläft!

Thu Mar 11 18:22:15 CET 2021

/dev/sda: ST10000VN0008-2PJ103: drive is sleeping

/dev/sdc: ST8000VN0022-2EL112: drive is sleeping

/dev/sdb: WDC WD5000LUCT-63RC2Y0: 40°C

/dev/sda:

drive state is: standby

/dev/sdc:

drive state is: standby

/dev/sdb:

drive state is: active/idle

Wird weiter beobachtet, scheint aber gut zu funktionieren!

Frage:

- Wurde alles korrekt durchgeführt?

- Kann man die Schreib / Lese geschwindigkeit beeinflussen?